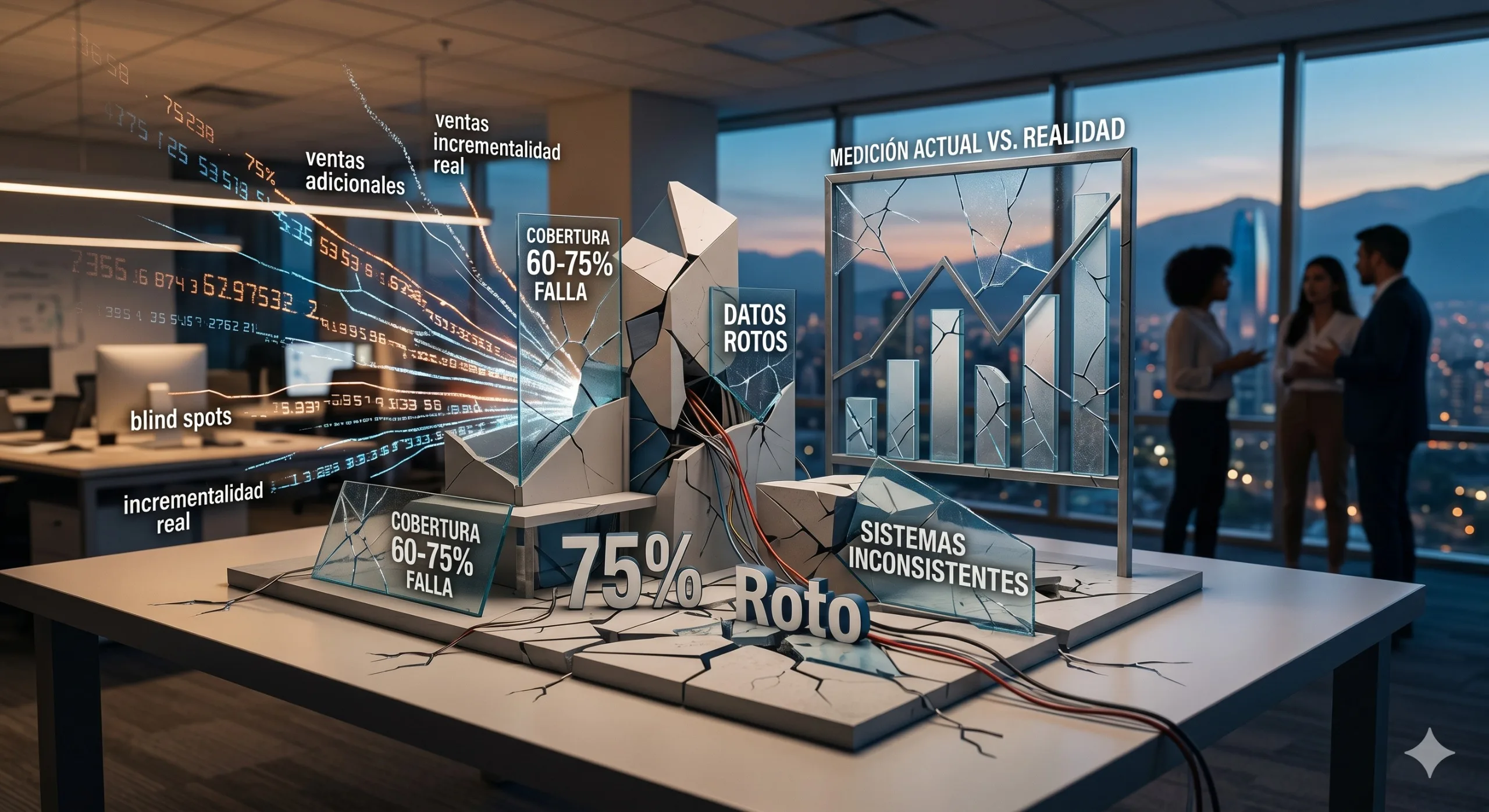

El 75% de los marketers admite que su medición está rota: IAB State of Data 2026

El 75% de los marketers admite que su medición está rota

Hace unos meses conversé con una directora de marketing de una empresa de consumo masivo en Santiago. Llevaba tres años construyendo lo que llamaba "nuestro sistema de medición": Google Analytics, Meta Ads Manager, un CRM conectado a medias, y un Excel de cierre que juntaba todo al final del trimestre.

Le pregunté cuánto de su inversión podía defender con datos de incrementalidad real, no de entrega ni de atribución last-click. Se quedó en silencio. Después dijo: "Quizás el 40%. El resto lo defiendo con histórico y presión de agencia."

No estaba sola. El IAB publicó en 2026 el State of Data Report, su análisis anual más amplio sobre el estado de la medición de marketing. El número que resonó en toda la industria: entre el 60% y el 75% de los marketers encuestados admite que sus sistemas fallan en alguna de estas tres dimensiones — cobertura, consistencia, o confianza. Y el dato más duro: ningún encuestado, ni uno solo, dijo que su Marketing Mix Modeling cubre todos sus canales pagados.

Ninguno.

Ese número merece un momento de pausa antes de seguir leyendo.

3 razones por las que el problema es estructural, no de herramientas

Cuando un dato así aparece en un reporte de industria, la primera reacción es buscar culpables: la agencia no integró bien los datos, el proveedor vendió algo que no funcionaba, el equipo interno no tenía presupuesto. Todas esas explicaciones tienen algo de verdad. Pero el problema es anterior a todas ellas.

1. Los sistemas de medición fueron diseñados para un mundo que ya no existe

La infraestructura de medición que usa la mayoría de las empresas en LATAM — y en el mundo — fue construida durante la era del tracking por cookies de terceros. Un mundo donde el journey del usuario era, en teoría, trazable de principio a fin: veía el aviso, hacía click, compraba, y el sistema registraba todo el camino.

Ese mundo cerró. La depreciación de cookies de terceros, el aumento de ad blockers, las restricciones de iOS en el tracking cross-app, y la fragmentación de la atención en docenas de canales simultáneos rompieron el supuesto central del sistema. Pero los dashboards siguen ahí, reportando con la misma confianza de siempre, como si nada hubiera cambiado.

El resultado es una medición que mide lo que puede medir, no lo que importa. El IAB lo documentó con precisión: la cobertura promedio de los sistemas de medición actuales está muy lejos del 100% del gasto. La brecha no es un problema técnico que se resuelve con un conector de datos. Es una herencia de diseño de sistemas construidos para journeys lineales y cookies eternas.

2. El MMM existe, pero cubre solo una fracción del gasto real

El reporte del IAB documentó algo que los practitioners sabían pero que pocas veces se decía en voz alta: incluso las empresas que tienen Marketing Mix Modeling activo fallan en cobertura. Ningún encuestado dijo que su modelo captura todos los canales en los que invierte.

¿Por qué? Porque construir un MMM que integre TV abierta, streaming, radio, OOH, digital display, search, social y e-commerce — con la granularidad temporal y geográfica necesaria para ser accionable — es un problema de data engineering antes de ser un problema estadístico. La mayoría de los modelos captura bien lo digital porque ahí está la data limpia, estandarizada, accesible por API. Lo offline queda fuera, en el mejor caso estimado con proxies, en el peor caso invisible.

Y si lo offline queda fuera del modelo, el modelo subestima sistemáticamente su contribución. El mix se inclina hacia lo digital en el presupuesto siguiente. La sobreinversión en performance crea una ilusión de ROAS alto que se autosostiene, hasta que el crecimiento orgánico se agota y nadie entiende por qué las ventas ya no responden al gasto.

Este es el ciclo que el IAB está documentando. No es nuevo, pero ahora hay datos de industria que lo confirman a escala.

3. Los incentivos no están alineados hacia la integración

Hay un tercer problema, menos técnico pero igual de real: a casi nadie en el ecosistema le conviene que la medición sea integrada y honesta.

Las plataformas digitales — Meta y Google en primer lugar — tienen sistemas de reporting que maximizan la atribución de conversiones a sus propios canales. No por malicia, sino por diseño: cada plataforma mide su propia contribución desde su propio sistema, sin vista a los demás canales. El resultado es que si sumás los ROAS de todas las plataformas en las que invertís, el total suele superar el 100% de las ventas reales. Cada una se atribuye más de lo que hizo. Si querés profundizar en este punto, lo analizamos en detalle en ¿Y si tus métricas de marketing mienten?.

El ángulo LATAM: el mismo problema, amplificado

Los números del IAB son globales, pero el problema se amplifica en Chile, México, Colombia y Perú por dos razones concretas.

Primero, el mix de medios en LATAM sigue siendo profundamente multicanal. TV abierta y streaming combinados representan entre el 20% y el 40% del mix en categorías de consumo masivo. Radio mantiene frecuencia y alcance a costo bajo en mercados donde la penetración digital no es universal. OOH genera entre el 5% y el 15% de venta incremental en categorías de impulso. Todos estos canales aparecen en el Excel de inversión de cualquier marca mediana en la región. Casi ninguno aparece en una medición seria de performance.

Segundo, los equipos de marketing en LATAM son más pequeños y los presupuestos de herramientas de medición son proporcionalmente menores. Una empresa con 50 millones de pesos chilenos mensuales en inversión no tiene el mismo acceso a infraestructura de datos que un retailer global. Sin esa infraestructura, construir un MMM que integre lo offline no es solo costoso — es logísticamente complejo.

Lo que el IAB documenta como promedio global es, en LATAM, el doble del problema: la brecha de cobertura es más grande, y los recursos para cerrarla son más escasos. El resultado práctico es que muchas marcas de la región operan con modelos de atribución que capturan, en el mejor de los casos, el 40% de su mix real.

Qué hace un MMM moderno en este contexto

La respuesta obvia al diagnóstico es implementar MMM. Pero el IAB también es honesto sobre esto: tener un modelo no es suficiente si el modelo cubre solo la mitad de los canales.

Un MMM que funciona en el contexto de 2026 tiene que cumplir tres cosas que la mayoría de los modelos actuales no cumple simultáneamente.

Integración de datos offline. TV, radio y OOH tienen que entrar al modelo con sus propias series temporales de inversión, con variables de control para estacionalidad y eventos. Robyn, el framework open source de Meta, permite este nivel de integración. No es trivial de implementar, pero es posible — y es lo que diferencia un modelo que dice algo accionable de uno que reporta lo que ya sabías.

Actualización frecuente. Un modelo que se corre una vez al año no es operacionalmente útil para decidir el budget del próximo trimestre. La infraestructura moderna, con TimesFM para forecasting de series temporales y procesos de re-entrenamiento automatizados, permite ciclos de actualización semanales o quincenales.

Calibración contra tests de incrementalidad. Un MMM bien construido no reemplaza los geo tests ni los incrementality tests — los usa como priors para calibrar los coeficientes del modelo. El resultado es un sistema que mejora su precisión con el tiempo, en lugar de acumular sesgo silencioso.

Qué NO hace un MMM, por más bien construido que esté

Esta sección importa tanto como la anterior, porque la sobreestimación de lo que el MMM puede hacer es tan peligrosa como no tenerlo.

Un MMM no te dice qué creativo específico usar. No resuelve la pregunta de qué mensaje resonó mejor con qué audiencia — para eso existen los tests creativos dentro de cada plataforma.

Un MMM no reemplaza los geo tests. Los tests de incrementalidad geográficos siguen siendo la prueba más directa de causalidad. El MMM usa esos resultados como insumo de calibración, no los elimina.

Un MMM no funciona con menos de 6 a 12 meses de data histórica consistente. Si la data tiene gaps, cambios de metodología en el medio, o períodos sin inversión en algún canal, el modelo va a tener serias dificultades para estimar contribuciones confiables. Empezar a medir bien hoy es el prerrequisito antes del modelo.

Y el punto más importante: un MMM no reemplaza el juicio del equipo. Los coeficientes del modelo son estimaciones con intervalos de confianza, no verdades absolutas. La decisión de cuánto invertir en cada canal sigue siendo del equipo, informada por el modelo, no delegada a él.

Qué hacer con esto la semana que viene

El reporte del IAB no es una invitación al pesimismo. Es un diagnóstico con dos lecturas posibles.

Primera: si el 75% está fallando, la brecha entre los que miden bien y los que no es una ventaja competitiva real para quien la cierra primero. Las marcas con mejor vista de su mix incremental toman mejores decisiones de presupuesto — no en abstracto sino en pesos concretos que dejan de gastarse donde no generan venta adicional.

Segunda: si ningún modelo cubre todos los canales, el objetivo no es la cobertura perfecta sino la cobertura relevante. Un MMM que integra el 80% del gasto con buena granularidad temporal es infinitamente más accionable que un Ads Manager que reporta el 100% de los clicks pero ninguna causalidad.

El primer paso práctico es hacer el inventario honesto: ¿qué porcentaje de tu inversión total entra hoy a tu sistema de medición principal, no como dato de tracking, sino como variable en un modelo de contribución que estima incrementalidad? La mayoría de las marcas con las que trabajamos en Neuroradar llegan a ese número y se sorprenden. El promedio está entre el 45% y el 60%.

Esa cifra, más que cualquier otro número del reporte del IAB, es el punto de partida real para mejorar la medición.

Si querés ver cómo se ve ese inventario en la práctica, tenemos un template en el dashboard demo: dashboard.neuroradar.ai/dashboard-demo. Sin login, sin formulario. Si preferís discutirlo en contexto del mix propio, 25 minutos es suficiente para tener 2 o 3 hipótesis sobre dónde están los blind spots más grandes.

Cierre

El problema de medición no es que las herramientas sean malas. Es que estamos usando herramientas diseñadas para preguntas distintas a las que necesitamos responder hoy.

Un dashboard de plataforma responde "¿cuántas conversiones se atribuyeron a este canal?". Lo que el CFO pregunta es "¿cuántas ventas adicionales generó esta inversión?". Esas son preguntas distintas. El IAB acaba de documentar que el 75% de la industria lo sabe — y que casi nadie tiene todavía la respuesta a la segunda.

La buena noticia es que la distancia entre esas dos preguntas nunca fue tan corta como ahora.

Preguntas frecuentes

¿Qué reveló el IAB State of Data 2026 sobre medición de marketing?

Entre el 60% y el 75% de los marketers encuestados por el IAB admite que sus sistemas de medición fallan en cobertura, consistencia o confianza. El dato más significativo: ningún encuestado, ni uno solo, afirmó que su Marketing Mix Modeling cubre todos los canales pagados en los que invierte. Fuente: IAB State of Data 2026.

¿Por qué los sistemas de medición no cubren el mix completo?

Los sistemas actuales fueron diseñados para journeys lineales con tracking por cookies de terceros. Con la depreciación de cookies, las restricciones de iOS y la fragmentación en múltiples canales, miden una fracción del mix real. Lo offline — TV, radio, OOH — raramente entra a los modelos aunque puede representar entre el 20% y el 40% del mix total en consumo masivo.

¿Cuánto del presupuesto se puede defender con incrementalidad real en LATAM?

Según nuestra experiencia con marcas en LATAM, el promedio está entre el 45% y el 60% del gasto total. El resto se decide con histórico de plataforma, presión de agencia o intuición — ninguno de los tres es incrementalidad real.

¿Cuántos datos históricos necesita un MMM para funcionar correctamente?

El mínimo recomendado es entre 6 y 12 meses de data histórica consistente con la misma granularidad temporal (semanal o diaria) en todos los canales. Con menos data o con gaps en el histórico, los intervalos de confianza del modelo son demasiado amplios para tomar decisiones de inversión confiables.

¿Qué diferencia hay entre lo que reporta una plataforma y la incrementalidad real?

Una plataforma reporta conversiones atribuidas a su propio canal usando su propio modelo de atribución. La incrementalidad mide cuántas ventas adicionales generó una inversión comparado con un escenario sin esa inversión. Si sumás los ROAS reportados por todas tus plataformas simultáneamente, el total habitualmente supera el 100% de tus ventas reales — cada plataforma se atribuye más de lo que hizo.